Blog

Si estás siguiendo el curso gratuito online de Iniciación en Mistika, estos archivos te van a venir muy bien!

Los "Gestures" de Mistika, activables desde botón central/rueda. También puedes utilizarlos desde una Wacom, configurando su funcionalidad completa.

Si necesitas los Hotkeys o cómo configurar tu Tangen Ripple, consulta este documento.

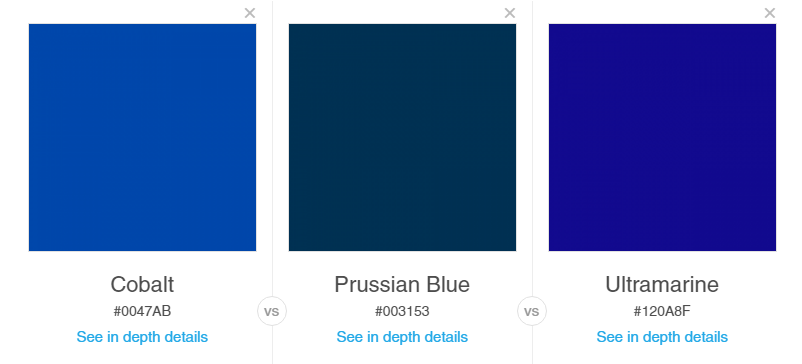

Para los colores existen nombres. Cuando son propios, estos colores son más difíciles de ser referenciados.

Nos imaginaremos lo mismo al mencionar la palabra Azul?

Existen muchos azules, y el más preciado en las antiguas épocas de los pigmentos naturales era el que se podía conseguir de la piedra Lapizlázuli, tan cara como el oro, que los europeos por tener que importarla desde Asia por vía marítima bautizaron a este azul como Ultramar.

El coste de tan preciado azul caracterizó a la pintura por encargo, transformando la presencia de ciertos colores en una forma de valor monetario, el cual entraba en conflicto con el valor moral o artístico de una obra. Determinados colores comenzaban entonces a ser centro de debates plásticos.

El avance de la química moderna hizo posible la aparición de nuevos pigmentos azules de menor valor, por ejemplo el usado por el ejército de Prusia para sus uniformes. El azul Prusia es color resultante del ferrocianuro de hierro, descubierto en Berlín en el siglo XVII.

Por su lado, un químico suizo consigue descubrir en el siglo XVIII el causante del color azulino que ya los antiguos egipcios manipulaban en forma de esmalte. El componente químico era el Cobalto, el cual al oxidarse y combinarse con óxido de aluminio se transforma en un potente y económico pigmento.

Estos colores son comercializados en forma de colorantes que seguramente en el siglo XXI no poseen ya ningún componente original.

Los tres son variedades de azul. Hoy podríamos representarlos bajo el espacio sRGB:

Cada uno de ellos es representado a través de la combinación de intensidades de luces de color RGB, las cuales deben regularse de acuerdo a un estandar que en el caso de las pantallas de computadora es el sRGB, que define coordenadas colorimétricas exactas para el azul, verde y rojo. Para hacer coincidir nuestro monitor con el estandar deberemos calibrar el monitor, garantizando así una adecuada gestión del color.

Pero la técnica del color no se trata de la calibración, sino que es sólo su punto de partida.

Más allá del estandar sigue perdurando en el medio digital el concepto de Paleta. Y en ella se colocarán pigmentos, ahora virtuales, que caracterizarán la obra audiovisual. Definir paleta entonces es elegir trabajar dentro de un subset de colores seleccionados bajo un criterio plástico, el cual debe subordinarse a criterios discursivos. Y hasta ahora he hablado acerca de uno sólo de los colores...

Cuales serán entonces tus pigmentos?

Últimamente me he encontrado con colegas que han presenciado disertaciones super interesantes acerca de ciencia del color, a veces pagando grandes sumas por estos eventos, o a veces de forma gratuita pues fueron disertaciones dictadas por marcas de luminarias. Yo he concurrido a una de estas últimas. En todos los casos, los colegas me han compartido sus impresiones y han llegado muchos a conclusiones erradas, o manifestando que simplemente les pareció muy técnico y por ello no terminaban de entender el problema de fondo. Algunos, simplemente me confesaron que no entendieron nada de nada. Es que el tópico no es nada sencillo si no se comprenden algunos conceptos elementales antes de empezar a adentrarse en la Ciencia del Color.

Espectro puede querer decir fantasma, una manifestación visible de algo inmaterial.

En óptica, los objetos y las luces poseen una propiedad que no es color, sino espectro. Como lo que podemos ver es sólo la impresión sensorial y no el rango de longitudes de onda que poseen las cosas, sentimos colores en vez de espectros, y esa es la característica de la visión que es metamérica, algo muchas veces mal explicado en interntet como "algo malo a evitar".

Lo que hay que evitar en todo caso es la falla metamérica que es justamente cuando un color varía de acuerdo a las combinaciones espectrales entre luces y/o objetos. El metamerismo es la condición psicofísica del sistema visual humano, estamos intermediados por esta forma de percibir y no hay manera de evitarlo. Simplemente debemos comprenderlo como un mecanismo.

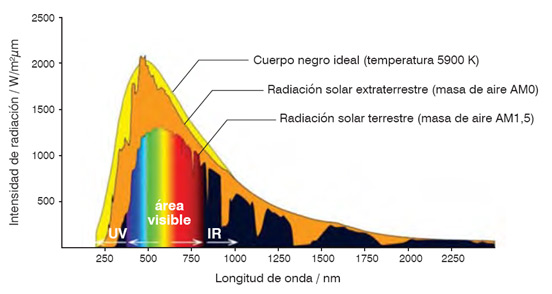

Frente a fenómenos visibles que parecen mágicos, la ciencia utiliza modelos abstractos que explican la realidad. Newton analizó la luz solar pudiendo descomponerla gracias a la dispersión de un prisma y llegando a hacer visible lo oculto en la luz blanca, abriendo un abanico de colores bautizado como espectro, el cual ahora agrega el sentido de rango, en este caso de longitudes de onda, las cuales se traducen en intensos colores.

La fuente de luz natural, el sol, emite un blanco que posee un rango de longitudes determinado y estudiable, un espectro continuo que va del rojo hasta el violeta.

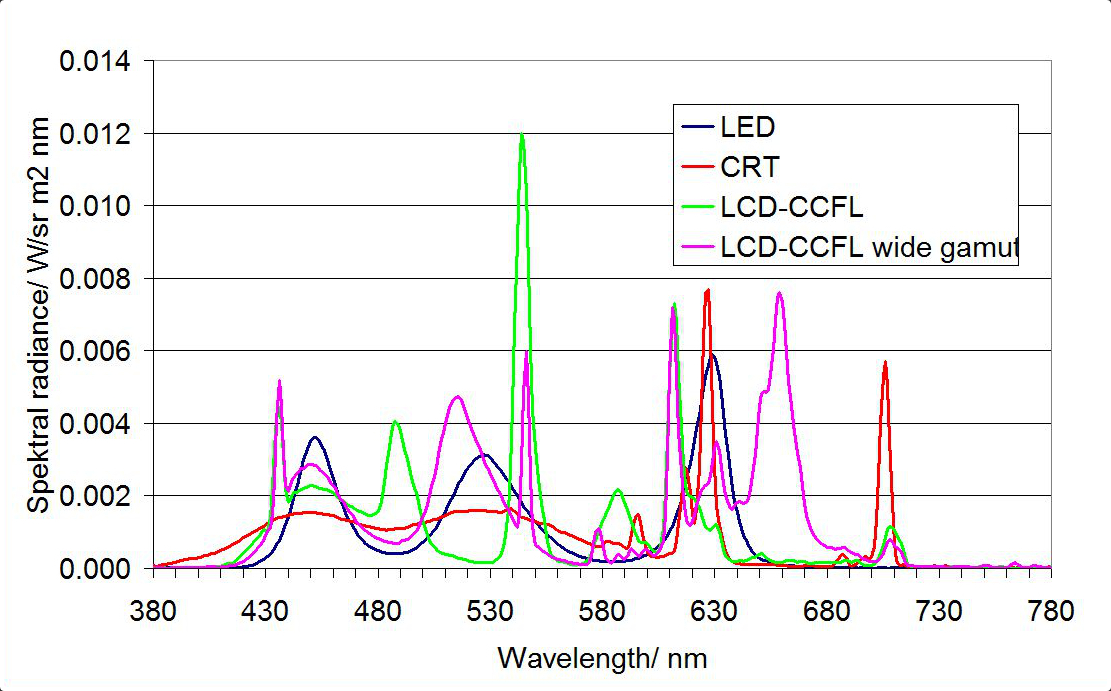

En la modernidad, el dominio sobre la química y la física hicieron posible la creación de fuentes de luz muy intensas con poco consumo energético pero de espectro discontinuo, las cuales al descomponerse con un prisma o un "espectrómetro" mostrarán ausencias de muchas longitudes de onda. Estas intensidades de emisión de longitudes de onda se pueden representar sobre un eje cartesiano donde el eje horizontal grafica las longitudes de onda del rango visible, mientras que el eje vertical grafica la intensidad relativa de cada una de las longitudes presentes en la fuente de luz.

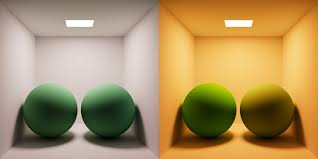

Hoy utilizamos fuentes de luz que combinan pocas longitudes de onda, las cuales sumadas dan como resultado una luz blanca. Mezclando entonces longitudes que se reconocen con correspondientes a los colores rojo, verde y azul se puede entonces "sintetizar" luz blanca. Las luces basadas en múltiples LED de colores como Kino Flo Freestyle o las ARRI Orbiter ofrecen soluciones a lámparas que regulan el color generado gracias a atenuar múltiples lámparas de diferentes colores primarios otorgando una vasta paleta de colores posibles. Pero estas lámparas se basan en mezclar diferentes espectros angostos, lo cual generará discontinuidad y también fallas metaméricas. Fuentes de espectro discontinuo (lámparas fluorescentes) o fuentes compuestas por lámparas de colores led pueden generar fallas metaméricas haciendo que la luz, aun percibiéndose blanca ilumine a dos objetos de diferente color, que sin embargo se perciban de igual color. En cambio con una fuente de espectro continuo (por ejemplo tungsteno), estas diferencias de color de objeto se tornarían fácilmente perceptibles.

En el ejemplo se observa una luz fluorescente a la izquierda y un tungsteno a la derecha. Con la luz de espectro discontinuo de la izquierda, los dos objetos parecen del mismo color, pero sus reflectancias espectrales eran diferentes y recién lo percibiremos bajo una luz de espectro continuo:

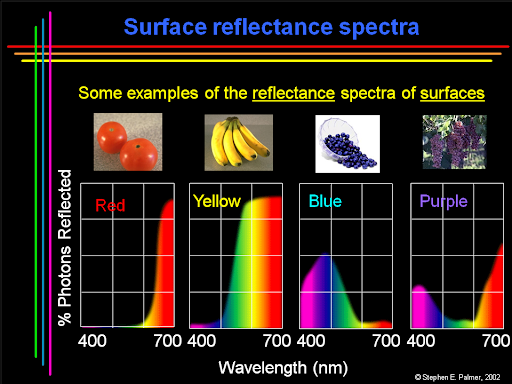

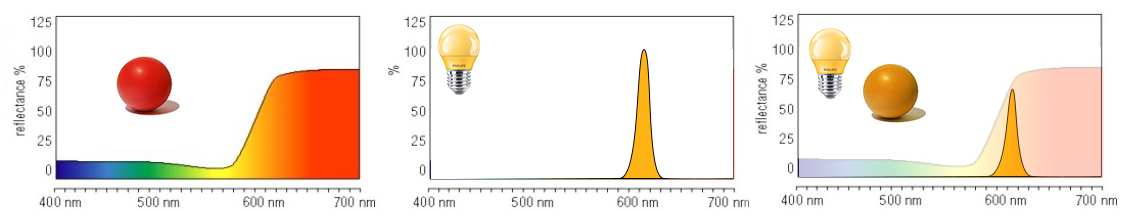

Si pensamos en los objetos, estos reflejan colores que también se pueden comprender como espectros. La reflectancia de los objetos es también representable como una curva espectral en un eje cartesiano.

En general los objetos absorben una gran cantidad de longitudes de onda, y el resto las reflejan o refractan como espectros contínuos y anchos, esto quiere decir que un objeto "rojo" puede estar reflejando no sólo la longitud de onda que podemos reconocer como ese rojo, sino además un gran conjunto de longitudes de onda similares que de alguna manera escoltan a la longitud dominante rojiza. Este "ancho" espectral es característico en los objetos, e incluso en su gran mayoría es lo suficientemente ancho como para hacer capaz de reflejar el total del espectro sin ser un objeto "blanco" o "acromático" sino resultar en un color apenas menos vibrante en comparación a una luz de una sóla longitud de onda.

Por lo que un objeto cuando refleja luz, aunque lo veamos de un sólo color, en realidad está reflejando una gran cantidad de longitudes. Pero...¿qué sucede cuando la fuente de luz a reflejar es de una sola longitud de onda o de espectro angosto?

Sencillamente el objeto reflejará las longitudes que no absorbe. Así que si el objeto "rojo" recibe una luz de espectro angosto "ambar", lo más probable es que refleje esa longitud que es escolta de la dominante, haciendo que el objeto se vea naranja y no rojo.

Si el objeto se ilumina con un espectro angosto naranja, entonces reflejará el naranja, pero ahora el objeto parecerá mucho más saturado que antes, puesto que el resto de espectro que puede reflejar con mucha menor intensidad está ausente en la luz, haciendo que este parezca a nuestra vista más vibrante que lo normal. Entonces luz y objeto interactuan, y en un gráfico de espectros ambas curvas son combinables, prediciendo así el color reflejado del objeto.

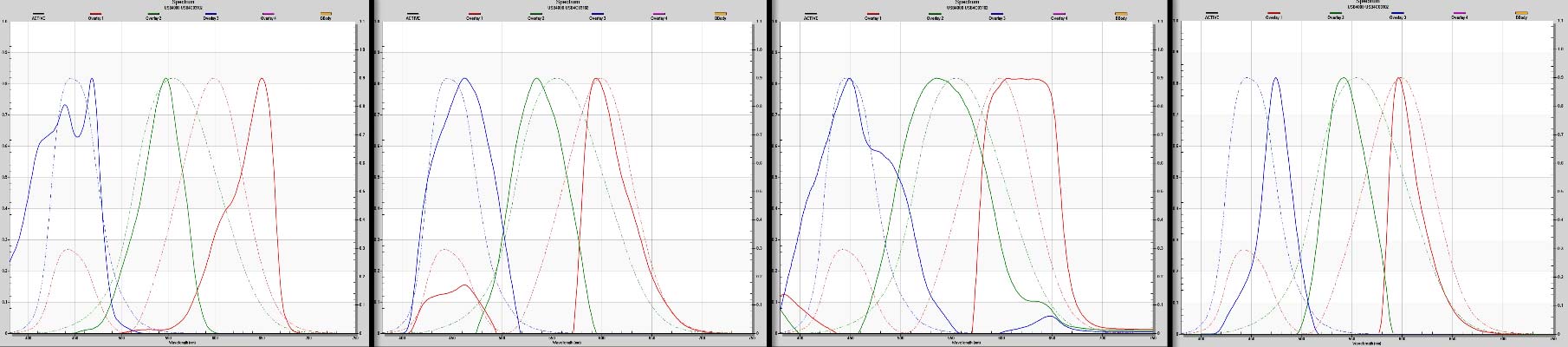

Los sensores electrónicos poseen respuesta espectral. Esto define un ancho de logitudes de onda que generalmente incluso es superior al de la visión humana, siendo sensibles a longitudes no visibles por debajo de la longitud correspondiente al rojo y por encima del violeta. De ahí sus nombres "infrarrojo" y "ultravioleta". Para que los sensores no transformen en voltaje eléctrico estas longitudes, se utilizan "filtros" que no permiten ingresar esa parte del espectro electromagnético. Y para el sensor color, se deberá realizar una separación en tres valores primarios a través de filtros de espectro ancho (Color Filter Array CFA) con la disposición de mosaico propuesta por Bayer. Estos filtros son en general los mismos en todas las cámaras pero luego los sensores, debido a sus diferentes sensibilidades para cada longitud de onda, poseen diferente eficiencia, la eficiencia cuántica, lo cual termina por definir la respuesta espectral característica de cada sensor. Las respuestas espectrales entonces son graficadas como tres curvas espectrales en un eje cartesiano.

Los sistemas de reproducción color aditivos como los proyectores digitales o los monitores poseen también su tecnología de síntesis de color, y cada una resulta en diferentes distribuciones espectrales.

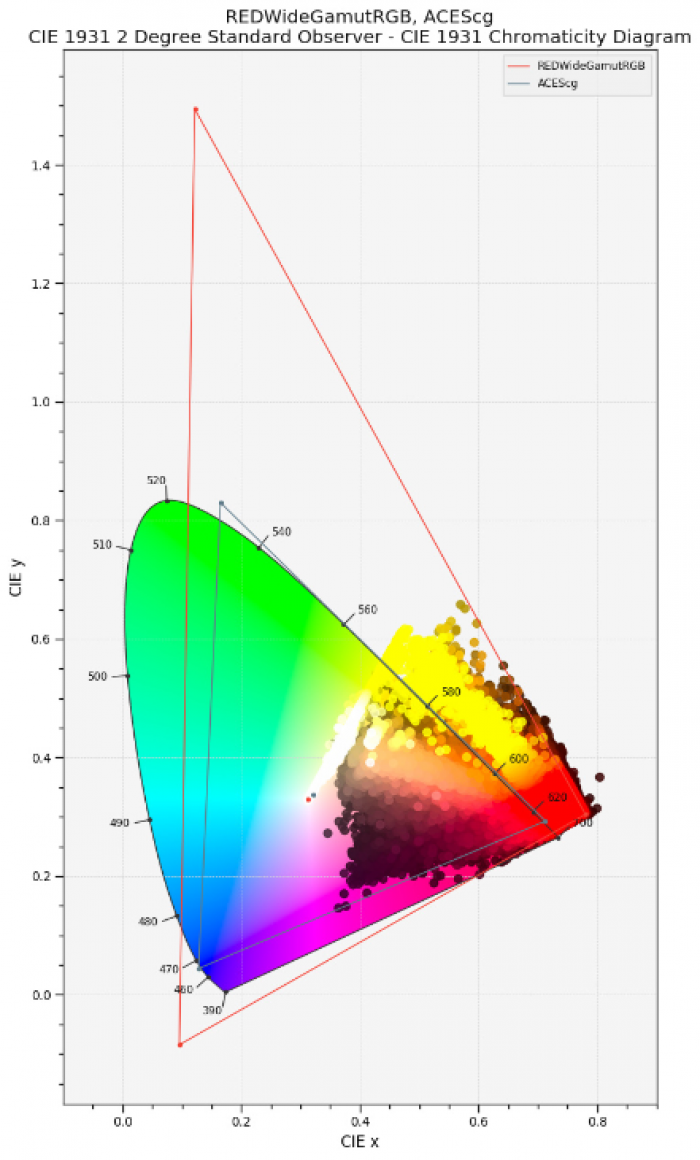

Cuando los objetos son iluminados por una fuente de luz de espectro ancho como el sol, el total de longitudes reflejables por el objeto llegan como un espectro ancho a la respuesta espectral de la cámara y este color deberá ser almacenado bajo un triplo de números RGB. Para ello los fabricantes, que cuentan sólo con respuestas espectrales de su sensor, deben diseñar un espacio de color nativo para traducir estas respuestas en intensidades de sólo tres valores colorimétricos. Como las respuestas espectrales generan gran variedad de colores alcanzando a sensar valores muy saturados, los fabricantes de cámaras definen primarios "imaginarios" de manera tal de definir tres coordenadas colorimétricas distanciadas con el fin lograr contener la amplia respuesta espectral. Esto hace parte de la "ciencia del color" del dispositivo de captura, caracterizando así la manera de almacenar el voltaje generado por el sensor bajo coordenadas de un espacio "nativo" de gamut amplio.

Estos gamuts son irreales, pues describen paletas de mucha saturación y los valores extremos en general no son reproducibles debido a que ya no son coordenadas dentro del spectral locus, o bien coordenadas por fuera de los estándares de reproducción color.

En esta imagen se compara el nativo "RedWideGamutRGB" con el AP1, el cual es casi idéntico al espacio Rec.2020 del UHD, y una nube de valores generados por la respuesta espectral de una toma hecha en cámara RED, almacenadas en el gamut amplio del fabricante:

Cuando comienzan a fabricarse las lámparas de espectro angosto, los objetos comienzan a reflejar más saturación que con fuentes anchas y las respuestas espectrales de las cámaras almacenarán en su espacio nativo valores colorimétricos imposibles de reproducir en monitores y proyectores, o incluso por fuera del "spectral locus" que encierra al gamut de lo visible. Estos valores "fuera del gamut del display" deben ser entonces o eliminados, lo cual genera un recorte indeseable en el detalle de los objetos retratados, o bien reubicados dentro del mapa de lo reproducible. El "remap" del gamut generará entonces múltiples distorsiones de color para reubicar lo que está fuera de gamut, pero perjudicando tambíen a valores "inocentes" que ya eran reproducibles por el display, y por ello es una operación compleja de "compresión" del gamut que debe hacerse con pericia.

El origen del problema es entonces la fuente de luz angosta que hace que los objetos cobren un color inusualmente saturado, el cual es capturable por la cámara en coordenadas imposibles de reproducir por el display.

Las fuentes basadas en lámparas multicolor generan entonces este tipo de conflicto, y para minimizarlo se debe regular inteligentemente la combinación de primarios de tal manera de generar luz que los objetos reflejen de manera ancha, para así no capturar luego colores fuera de gamut de reproducción.

También dependiendo de la respuesta espectral de cada cámara, compensar la falla metamérica de los colores compuestos, principalmente el blanco, y acomodar la mezcla aditiva de estas lámparas de acuerdo a la respuesta espectral de la cámara que está capturando la escena.

Y allí es donde cuesta más comprender las características de los controles modernos de estas luminarias nuevas. Por un lado, el problema de la falla metamérica, y por el otro, evitar luces monocromáticas que generen "out of gamut". Hoy en día, el mayor gamut representable completo en los monitores es el P3, y por ello conviene limitar las lámparas led aditivas a este gamut, para que los objetos no reflejen combinatorias demasiado saturadas para el display final, evitando así el gamut mapping hoy en día tan habitual al trabajar en ACES AP1 como así también bajo otras administraciones de color.

"No hay descripción del universo que no sea arbitraria y conjetural"

Borges

Pero entonces existen Leyes que rigen al universo?

Si nos quitáramos el eurocentrismo de encima, puede que pensemos como en China, donde en su cultura al universo se lo comprende a traves de modelos y no a través de Leyes. Estos modelos son una expresión de contraste entre valores que coexisten en tensión, laderas oscuras y claras de una misma montaña.

El Yin Yang, como resumen icónico, es el modelo binario por excelencia, donde este se corona con el I-ching que consta inicialmente de una notación binaria antiquísima. En el anillo exterior que representa al Pa Kua, ocho valores se consiguen combinando tres pares de rectas completas o quebradas (23=8 valores):

Dentro de cualquier modelo se implica un orden. En el caso del color, entonces el modelo suele ser de varias dimensiones y valores para así poder describir varias características del color. Incluso en este ícono de dos colores, ya hay una sugerencia del círculo cromático. Pero estas características son elegidas bajo criterios arbitrarios. El colmo de la arbitrariedad la podemos encontrar en esta lista citada por Borges en el cuento "El Idioma analítico de John Wilkins":

- pertenecientes al Emperador,

- embalsamados,

- amaestrados,

- lechones,

- sirenas,

- fabulosos,

- perros sueltos,

- incluidos en esta clasificación,

- que se agitan como locos,

- innumerables

- dibujados con un pincel finísimo de pelo de camello,

- etcétera,

- que acaban de romper el jarrón,

- que de lejos parecen moscas.

Esta enciclopedia china apócrifa citada por Borges inventariza a los animales dentro del Emporio celestial de conocimientos benévolos.

Para abstraer un sistema de orden menos arbitrario, los lectores de este artículo podrían clasificarse entre "personas que su nombre comienza con letra consonante", y desde esta clasificación pedirle a los integrantes de este grupo que den un paso a su derecha. Yo, Edi, quedaría en el lugar.

Otra clasificación basada en números y en escala absoluta podría ser "personas que miden menos de 1,70 metros". Si estás en este grupo, podría pedirte que te pongas de pie y te agaches un poquito. Si eres más alto, que te pongas en puntas de pie. Esto entonces generaría mayor contraste de altura entre los lectores, desde un punto de pivot definido en 1,70 metros. Yo, que mido 1,80 metros, debería ponerme en puntas de pie.

Gran cantidad de clasificaciones son posibles, pero esto depende del criterio de discernimiento. En el caso del color, "brillo" no es lo mismo que "luminosidad", o "brillantez". "Saturación" no es lo mismo que "Chroma", o "colorido". Debemos aprender bien todos los términos y qué describen del color. En sistemas de codificación numérica no es lo mismo valores "ab" que "uv", coexisten diferentes modelos matemáticos para codificar al color del pixel y cada uno permitirá modificaciones diferentes gracias a sus distintas dimensiones descriptivas del color.

Y por ello, toda clasificación aunque arbitraria y conjetural, puede encontrar su uso práctico. Incluso hasta las más absurdas.

En Internet como ya sabemos, las noticias falsas se propagan hasta a veces más rápido que las verdaderas. También permiten desarrollar la popularidad de una persona gracias a poder crear canales de comunicación con otros, a través de redes sociales.

La combinación de ambos fenómenos producen efectos muy negativos, dando lugar al Prestigio.

La raíz de la palabra "prestigio" viene del præstigum latino, significando un engaño, un truco o una artimaña. De aquí la raíz común con el Prestidigitador, la carta número uno del Tarot.

Esta carta, también traducida como “El Mago” posee una doble interpretación, pues en su improvisación y en el hacer, puede maravillar a sus espectadores. Aunque también embaucar a los pueblos que visita.

Es entonces el dilema que enfrentamos al lograr cierta maestría, la de convertirnos en un charlatán.

Maestría a su vez posee muchos usos: Arte y destreza en enseñar o ejecutar algo. Mas un excelente ejecutor no necesariamente es un buen docente.

Enseñar pone a cualquiera frente al desafío de teorizar, investigar, documentar e ilustrar con ejemplos lo que uno cree "saber", muchas veces por su experiencia como profesional.

Dentro de lo que a mi me toca enseñar, me encuentro rodeado de una confusión general que no distingue entre títulos que son muy diferentes. De esta confusión se nutren muchos que aprovechan de su situación de fama para alimentar un star system de la docencia del color.

Un científico de color es casi siempre parte de un órgano de investigación o de una universidad que posee un laboratorio, en donde estos estudian los fenómenos perceptuales. Fairchild, Webster y Gilchrist son entonces científicos que estudian fenómenos cercanos a procesos psicológicos y fisiológicos.

Un ingeniero de imagen digital crea herramientas de manipulación de color bajo entornos de programación, basando su conocimiento de matemáticas aplicado a los estudios del color. Daniele Siragusano, Roman Dudek, y Thomas & Jhon Knoll son ejemplos de este tipo de titulación, la cual puede combinarse o no con la anterior.

Un docente puede dominar o no con maestría un oficio. Pero un gran profesional no necesariamente posee un gran desarrollo como docente. El docente es, por sobre todas las cosas, un gran comunicador. A mi me gustaba cómo explicaba con sencillez Carl Sagan, un divulgador que inspiraba a querer a la ciencia.

Un instructor muchas veces capacita en el uso de una herramienta en particular. Por ejemplo, uno que te enseña a usar cualquier aparato o aplicación.

Científicos, Ingenieros, Docentes, Instructores. Todos pueden o no llevar con maestría su título, sea cual sea.

Cuando alguien que está en un proceso de búsqueda de información o queriendo encontrar cómo estudiar, rápidamente se encuentra en Internet con una gran oferta muy plagada de publicidad y también con algoritmos que orientan la búsqueda a lugares muy visitados. También las redes sociales y los servidores de video se llenan de formatos "tutoriales" los cuales son muy exitosos en la obtención de seguidores, uno de los mecanismos modernos del prestigio que muchos amateurs tienen como objetivo principal alcanzar con sus publicaciones.

La feroz competencia en esos nuevos medios hace que florezcan una gran cantidad de viralizaciones de conceptos falsos, malos entendidos técnicos, "estrellas de youtube" o "youtubers" dedicados a generar tutoriales que parecen prometer una autopista del conocimiento. El "certificado" es algo que en algunos países de latinoamérica se añora como algo de valor indiscutible. Surge también el concepto de usuario certificado, un concepto ambiguo que denota usar, algo muy lejano al concepto crear.

Por qué llamar entonces Científico de color a alguien que apenas asoma a algo elemental de Ingeniería? Por qué llamar Docente a un Instructor? Para qué insistir en la obtención de certificados de "usuario"? Por qué pensar que si alguien tiene Prestigio, es condición suficiente para considerarlo Maestro en alguna especialidad?